De tanto discutir sobre cuándo la tecnología iba a sobrepasar nuestras capacidades, perdimos de vista que las máquinas se estaban enfocando en conocer nuestras debilidades.

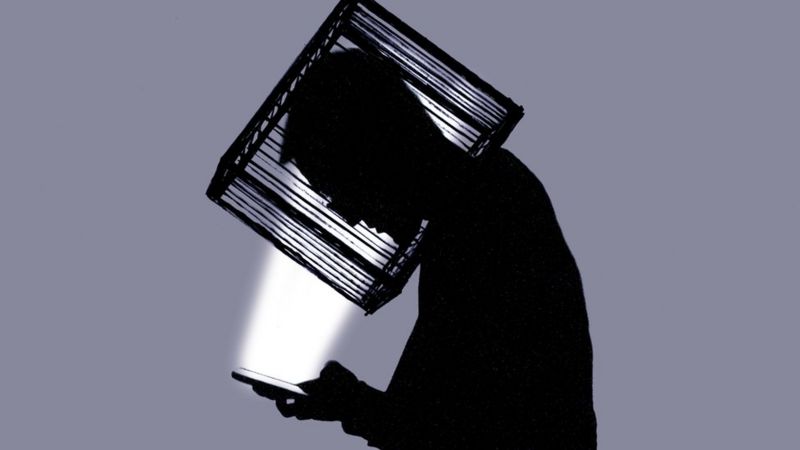

Es la base que sustenta un concepto que está resonando en Silicon Valley y que se conoce como human downgrading, “degradación humana” en español.

Fue acuñado por el científico informático Tristan Harris y su socio Randima (Randy) Fernando, cofundadores del Center for Humane Technology (CHT, Centro para la Tecnología Humana), una organización sin ánimo de lucro cuya misión es “revertir la degradación humana” y “realinear la tecnología con nuestra humanidad”.

En el reciente documental de Netflix The Social Dilemma (“El dilema de las redes sociales”) Harris y Fernando exponen esta cuestión, estrechamente ligada a la llamada “economía de la atención”, o cómo las empresas monetizan nuestra atención a través de las redes sociales y otras tecnologías digitales.

Fernando, director ejecutivo del CHT, cree que la tecnología debería ser “más humana”. En esta entrevista con BBC Mundo explica por qué.

¿Cómo surgió tu interés en la economía de la atención y por qué te parece importante?

Mis padres me enseñaron mindfulness (meditación basada en atención plena) y tecnología desde muy pequeño, así que yo seguí esa trayectoria. Me interesé mucho en las gráficas computacionales y trabajé en Nvidia (una multinacional de Silicon Valley) durante siete años. Después ayudé a fundar una organización llamada Mindful Schools para enseñar mindfulness en las escuelas.

Los dos estábamos muy interesados en la atención plena (midfulness). Comenzamos a darnos cuenta de que estábamos en contra de cómo la economía de la atención compite constantemente para entrenar nuestras mentes de forma distinta.

La economía de la atención es una adversaria de la atención plena.

A las empresas les resulta muy fácil configurar perfiles sobre nosotros en base a la información que compartimos en las redes sociales, y comparten esa información con los anunciantes. Este modelo de negocio hace que nuestra atención se vuelva vital y además no se fundamenta en nuestros intereses, sino en los de los anunciantes.

Tres años más tarde, seguimos en ello.

Para abordar el problema ustedes proponen “revertir la degradación humana”. ¿Qué significa eso?

Gran parte del trabajo que hacemos tiene que ver con la mente, con las adicciones y con cómo combatirlas; con la meditación y con el bienestar emocional. También con la democracia y la polarización, con la tergiversación de la verdad. Todos esos temas están interrelacionados y vinculados a la “degradación humana” (human downgrading).

Nosotros la describimos como algo cíclico: a medida que hemos ido mejorando y actualizando nuestras máquinas, hemos degradado a los seres humanos. Y debería haber sido al revés. Eso es algo que se repite constantemente.

“Los ‘nativos digitales’ son los primeros niños con un coeficiente intelectual más bajo que sus padres”

En un momento dado nos hicimos vulnerables a ella porque la tecnología puede usarse para aprovecharse de nuestras debilidades.

¿Qué ha cambiado en los últimos años para que este tema se haya puesto sobre la mesa dentro y fuera de Silicon Valley?

La “degradación humana” ha sobrepasado algunos límites importantes, por eso ahora está empezando a preocuparnos.

Vamos siendo conscientes de cómo las notificaciones tratan de “secuestrar” nuestra atención. Si los diseñadores lo usan a su favor pueden hacer que pasemos más tiempo en su producto, atraer nuestra atención para que nos fijemos en ciertos elementos a través de aspectos como el brillo de la pantalla y otros pequeños “trucos”.

Y ya no sabemos qué es real y qué no. Los deepfakes (videos con personas aparentemente reales modificados con inteligencia artificial) son un buen ejemplo de ello.